Des incertitudes sur les données d’entraînement

L’interview de Mira Murati, responsable technologique d’OpenAI, par le Wall Street Journal soulève des questions quant à l’origine des données utilisées pour entraîner Sora, la nouvelle IA de création de vidéos de l’entreprise. Murati a admis ne pas savoir exactement d’où venaient ces données, ce qui soulève des inquiétudes dans un contexte où l’industrie de l’intelligence artificielle est déjà critiquée pour ses pratiques en matière de données.

Une diversité d’inspirations provenant du web

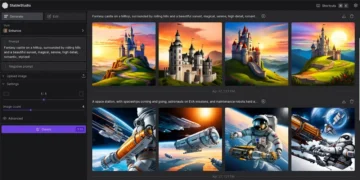

Bien que certaines données utilisées pour l’entraînement de Sora proviennent de Shutterstock, une banque d’images, il est probable que l’IA ait ingéré une multitude d’autres contenus provenant d’Internet. Des vidéos publiées sur Instagram et YouTube, notamment des séquences mettant en scène des chats et des caméléons, semblent avoir inspiré les capacités de Sora à générer des vidéos photoréalistes. Cependant, l’absence de transparence quant à la source de ces données soulève des préoccupations éthiques.

Risques de backlash et de controverse

Bien que les vidéos générées par Sora témoignent d’une qualité impressionnante, les incertitudes entourant l’origine de ses données d’entraînement pourraient entraîner des réactions négatives. En s’appropriant du contenu en ligne sans consentement explicite des créateurs, OpenAI risque de susciter des controverses similaires à celles actuellement observées dans le domaine de la photographie et du dessin, où les artistes sont préoccupés par l’utilisation non autorisée de leurs œuvres par les IA.

La Rédaction