Avec l’évolution rapide des technologies d’intelligence artificielle (IA), la capacité à détecter les textes produits par ces systèmes devient essentielle. OpenAI, leader dans le domaine de l’IA, s’efforce de développer un outil de détection capable d’identifier les textes générés par ses modèles, notamment ChatGPT. Cependant, cette initiative est confrontée à divers défis et préoccupations.

Les enjeux de la détection des textes générés par ChatGPT

La méthode du filigrane textuel

OpenAI explore une technique nommée filigrane textuel. Cette méthode consiste à intégrer une signature invisible dans les textes produits par ChatGPT, permettant de les identifier sans en modifier le contenu. Néanmoins, cette technologie présente plusieurs limitations :

- Vulnérabilité aux contournements : Les personnes malveillantes peuvent facilement contourner cette signature en modifiant légèrement le texte ou en utilisant des outils de traduction.

- Impact disproportionné : Les locuteurs non anglophones pourraient être injustement désavantagés par ce système.

Risques sociaux et éducatifs

La mise en œuvre généralisée de cet outil pourrait stigmatiser l’utilisation de l’IA comme assistance à l’écriture, en particulier parmi les étudiants et les professionnels non natifs anglais. Une enquête a révélé que 30 % des utilisateurs réduiraient leur utilisation de ChatGPT si ce système était mis en place.

Alternatives au filigrane textuel

Les métadonnées cryptographiques

Une autre approche étudiée par OpenAI concerne l’utilisation de métadonnées cryptographiquement signées. Contrairement aux filigranes textuels, cette méthode ne génère pas de faux positifs, mais son application reste complexe et pose également des questions éthiques et opérationnelles.

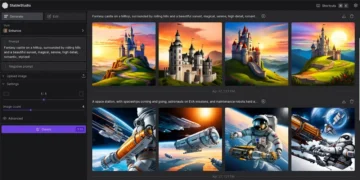

Watermarks audio et visuels

OpenAI envisage également d’utiliser des watermarks pour les contenus audio et visuels. Ces méthodes sont jugées potentiellement plus sécurisantes, surtout en période électorale. Toutefois, leur impact global sur les utilisateurs nécessite encore des études approfondies.

Perspectives futures et décisions équilibrées

Face aux défis identifiés, OpenAI adopte une approche réfléchie dans le développement et le déploiement de ces technologies. L’entreprise reconnaît qu’une solution mal conçue pourrait nuire aux groupes vulnérables et à l’écosystème plus large au-delà de sa propre sphère d’influence.

Le rôle crucial des retours des parties prenantes

Les discussions continues avec diverses parties prenantes, y compris le CEO Sam Altman et la CTO Mira Murati, jouent un rôle clé dans la prise de décision. Le feedback des utilisateurs et des éducateurs sera essentiel pour affiner et ajuster ces outils avant toute mise en œuvre à grande échelle.

Importance de l’éducation numérique

Il est impératif que les institutions éducatives sensibilisent sur l’utilisation éthique des technologies IA. Des formations axées sur une compréhension critique des outils IA peuvent aider à atténuer certains des risques liés à l’adoption de dispositifs de détection.

En somme, tout en explorant diverses options pour garantir l’intégrité des textes générés par IA, OpenAI doit naviguer prudemment entre innovation technologique et responsabilité sociale.

Source : Siécle digital